近年来,研究成为深度学习领域的热点。最近,,清华大学孙茂松组也发布了预印版综述文章 。除此之外,孙茂松组周界、崔淦渠、张正彦同学对 GNN 相关的综述论文、模型与应用进行了综述,并发布在 GitHub 上。

GitHub 链接:https://github.com/thunlp/GNNPapers

综述论文

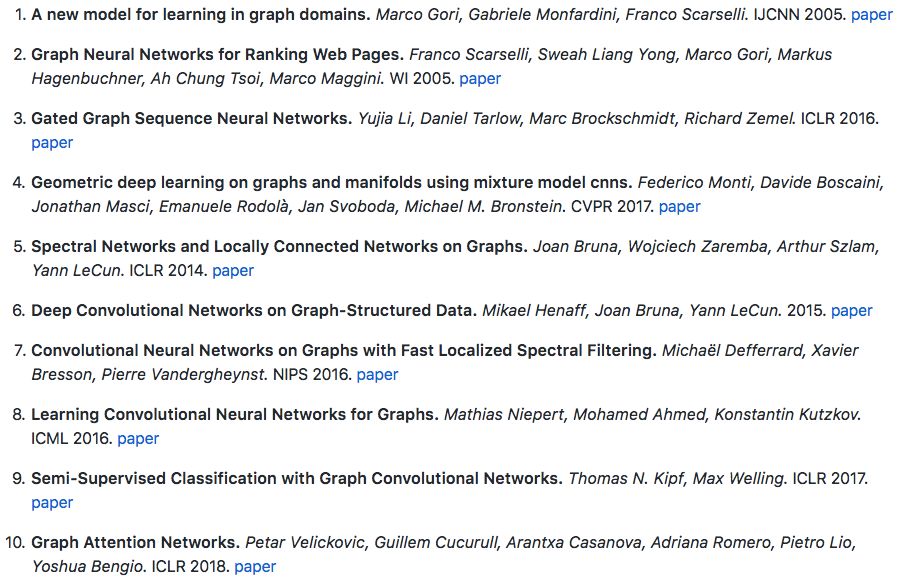

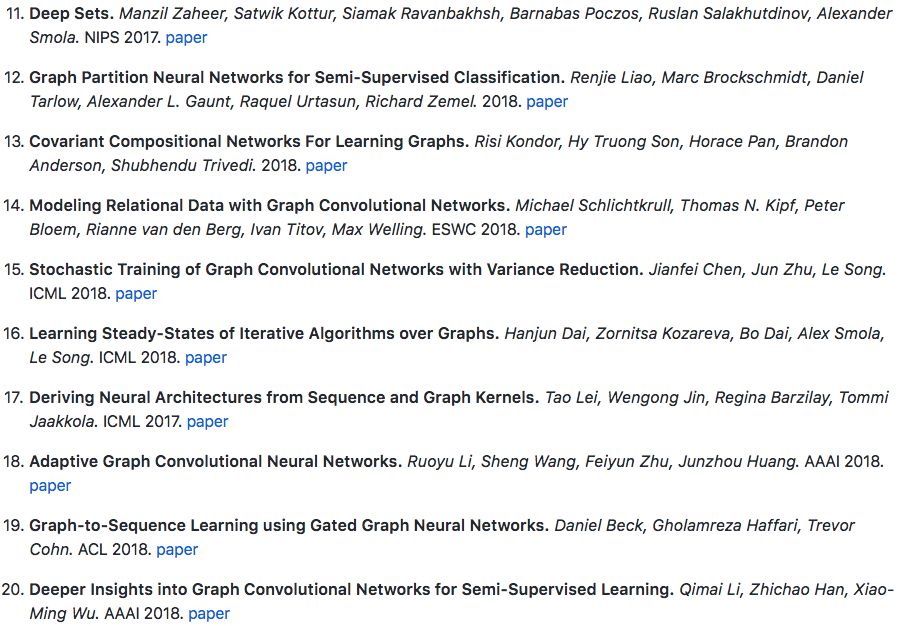

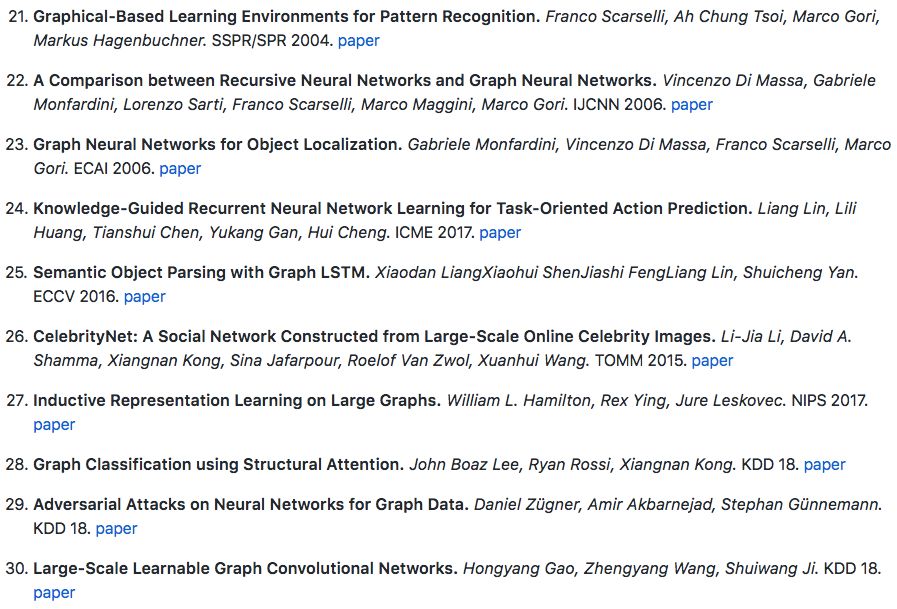

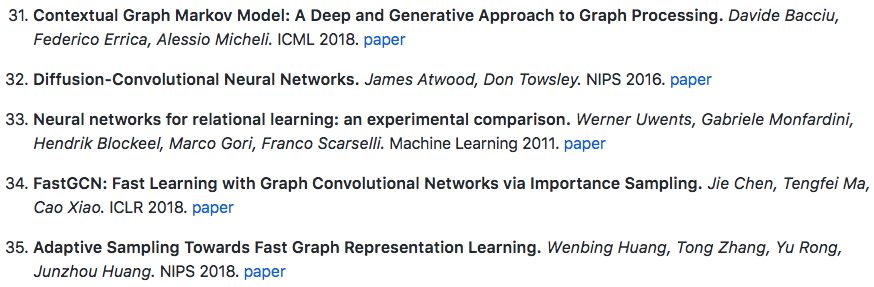

这部分共介绍了 8 篇论文,包括前面提到的清华大学的两篇综述论文。

模型

模型部分包括 35 篇论文,包括:

- Yoshua Bengio 发表在 ICLR 2018 上的论文《Graph Attention Networks》,该论文提出了基于近邻节点注意机制的网络架构 GAT,可用于处理复杂、不规则结构的计算图,并在三种困难的基准测试中得到了业内最佳水平,研究人员称该模型有望在未来处理任意不规则结构图。

- 谷歌发表在 ICLR 2018 上的论文《Graph Partition Neural Networks for Semi-Supervised Classification》,该论文提出了一种图神经网络的新变体——图分割神经网络(Graph Partition Neural Network,GPNN),该网络适用于处理大型图。

- 清华朱军等人发表在 ICML 2018 上的论文《Stochastic Training of Graph Convolutional Networks with Variance Reduction》,提出基于控制变量的图卷积网络(GCN),有效减少感受野大小。

- 腾讯 AI Lab 发表在 AAAI 2018 上的论文《Adaptive Graph Convolutional Neural Networks》,提出自适应图卷积神经网络 AGCN,可接受任意图结构和规模的图作为输入。

- 李佳等人发表在 TOMM 2015 上的论文《CelebrityNet: A Social Network Constructed from Large-Scale Online Celebrity Images》,提出了一种基于图像的社交网络 CelebrityNet,该网络基于名人照片中编码的隐性关系构建而成。

- KDD 2018 最佳论文《Adversarial Attacks on Neural Networks for Graph Data》,提出了针对图深度学习模型的对抗攻击方法,是首个在属性图上的对抗攻击研究;研究者还提出了一种利用增量计算的高效算法 Nettack。

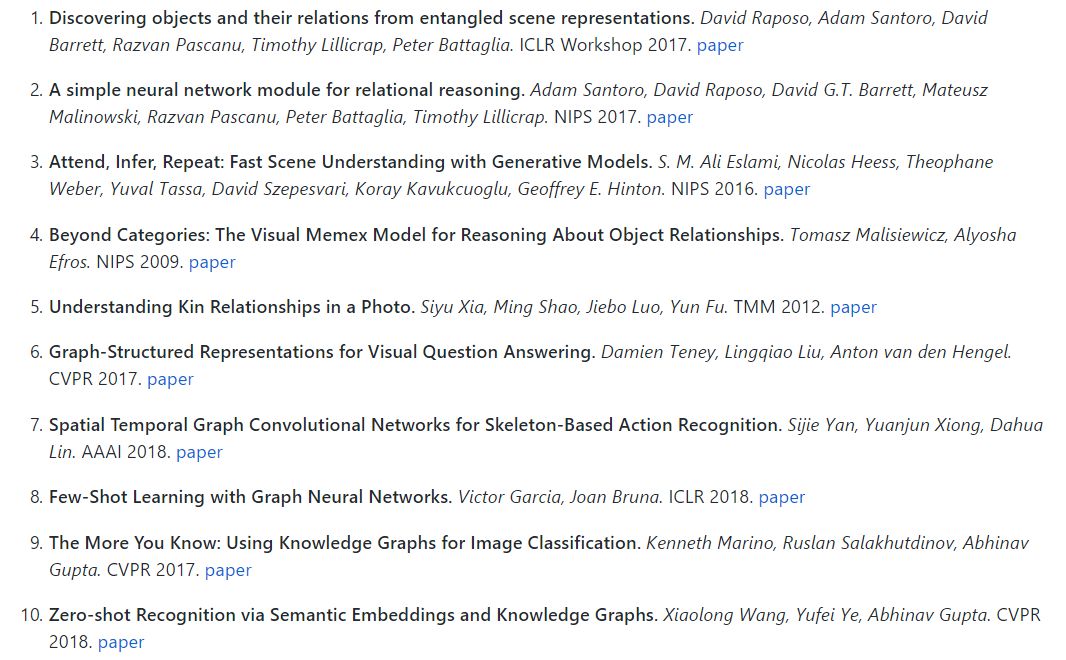

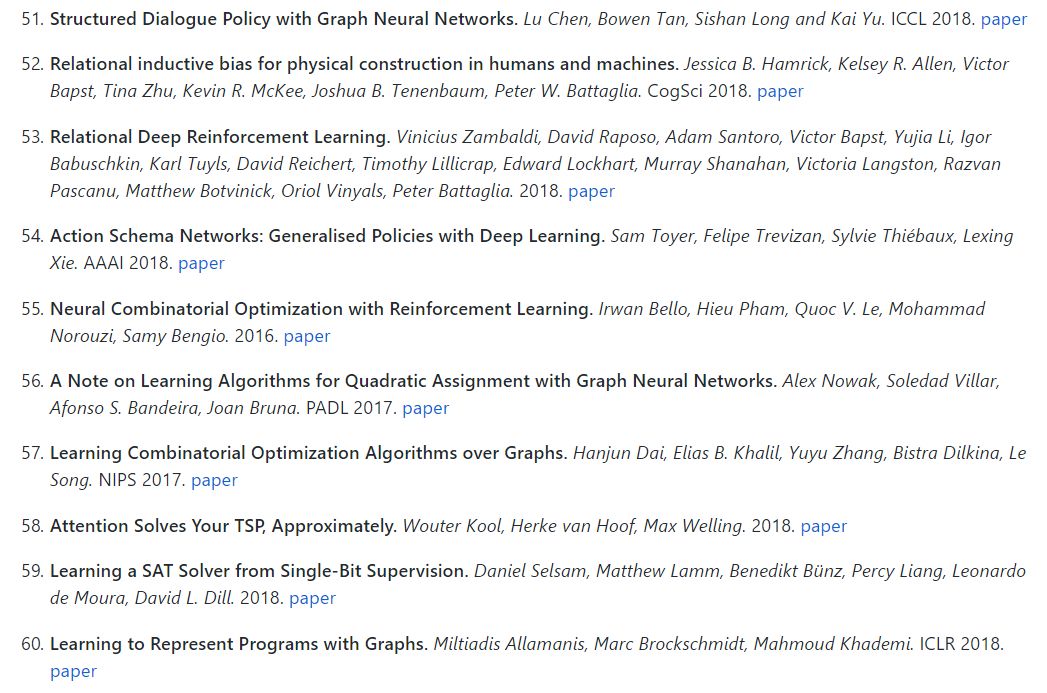

- 论文列表如下:

论文列表如下:

应用

应用部分有 86 篇论文,包括:

- DeepMind 发表在 ICLR 2017 上的论文《Discovering objects and their relations from entangled scene representations》和《Metacontrol for Adaptive Imagination-Based Optimization》,介绍了交互网络在场景理解和基于想象的决策(imagination-based decision-making)上的应用。

- Geoffrey Hinton 等人发表在 NIPS 2016 上的论文《Attend, Infer, Repeat: Fast Scene Understanding with Generative Models》,该论文提出了一个用于结构化图像模型(可以对目标进行明确的推理)中的有效推理的框架。这种方法是通过使用一个循环神经网络来执行概率推理——该循环神经网络可以处理场景元素且一次处理一个。关键的是,该模型自身可以学习选择合适数量的推理步骤。相比于监督式的方法,该网络可以产出更精确的推理,而且它们的结构也可以使归纳得到进一步的提升。

- 港中文发表在 AAAI 2018 上的论文《Spatial Temporal Graph Convolutional Networks for Skeleton-Based Action Recognition》,该论文提出了一种时空图卷积网络,并利用它们进行人类行为识别。这种算法基于人类关节位置的时间序列表示而对动态骨骼建模,并将图卷积扩展为时空图卷积网络而捕捉这种时空的变化关系。

- CMU 和谷歌的 CVPR 2018 Spotlight 论文《Iterative Visual Reasoning Beyond Convolutions》,提出了一种新的迭代视觉推理框架。该框架超越了目前只具备卷积堆栈推理能力的识别系统。该框架由两个核心模块组成:一个是局部模块,使用空间记忆以并行更新的方式存储以前的信念;另一个是全局图形推理模块。

- 谷歌发表在 NIPS 2017 上的著名论文《Attention Is All You Need》,提出了一种新型的简单网络架构——Transformer,它完全基于注意力机制,彻底放弃了循环和卷积。

- Christopher D. Manning 发表在 EMNLP 2015 上的论文《Effective Approaches to Attention-based Neural Machine Translation》,探讨了两种简单有效的注意机制类别:一种能顾及到所有源词的全局方法,以及一种只能一次查看源词的一个子集的局部方法。

- DeepMind 2018 年的研究《Relational Deep Reinforcement Learning》,提出了一种「关系性深度强化学习」方法,并在星际争霸 2 中进行了测试。

- 来自微软研究院和西门菲莎大学的研究者发表在 ICLR 2018 上的论文《Learning to Represent Programs with Graphs》,提出基于程序图简化程序分析,从源代码中学习。该方法结合基于数理逻辑和自然语言理解的程序分析方法,可以更准确地查找已发布软件中的 bug。

- 清华朱军等人发表在 ICML 2018 上的论文《Adversarial Attack on Graph Structured Data》,关注图神经网络的鲁棒性,即通过攻击(对抗)训练的方法来增强图神经网络分类的稳定性。

- Christopher D. Manning 等人发表在 ACL 2015 上的论文《Improved Semantic Representations From Tree-Structured Long Short-Term Memory Networks》,提出了改善语义表征的 Tree-LSTM,用于自然语言处理任务,在预测句子相关度和情感分类任务上表现优异。

- Christopher D. Manning 等人发表在 EMNLP 2018 上的论文《Graph Convolution over Pruned Dependency Trees Improves Relation Extraction》,提出一种用于关系提取的图卷积网络变体。

- UCLA 朱松纯教授等人发表在 ECCV 2018 上的论文《Learning Human-Object Interactions by Graph Parsing Neural Networks》,提出图解析神经网络(Graph Parsing Neural Network,GPNN),用于检测和识别图像和视频中人-物交互的任务。

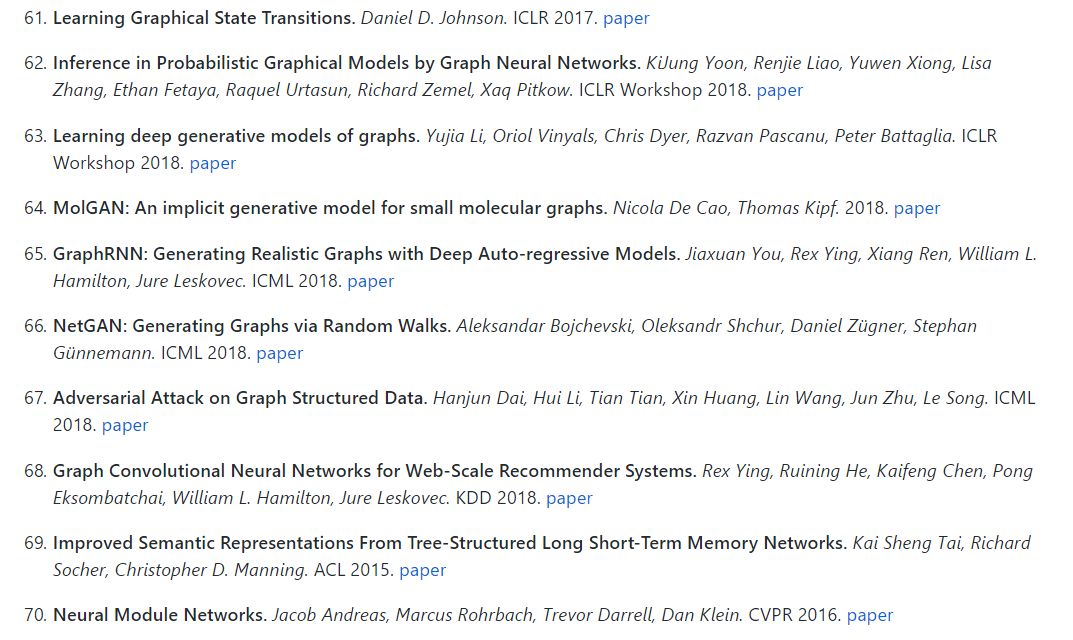

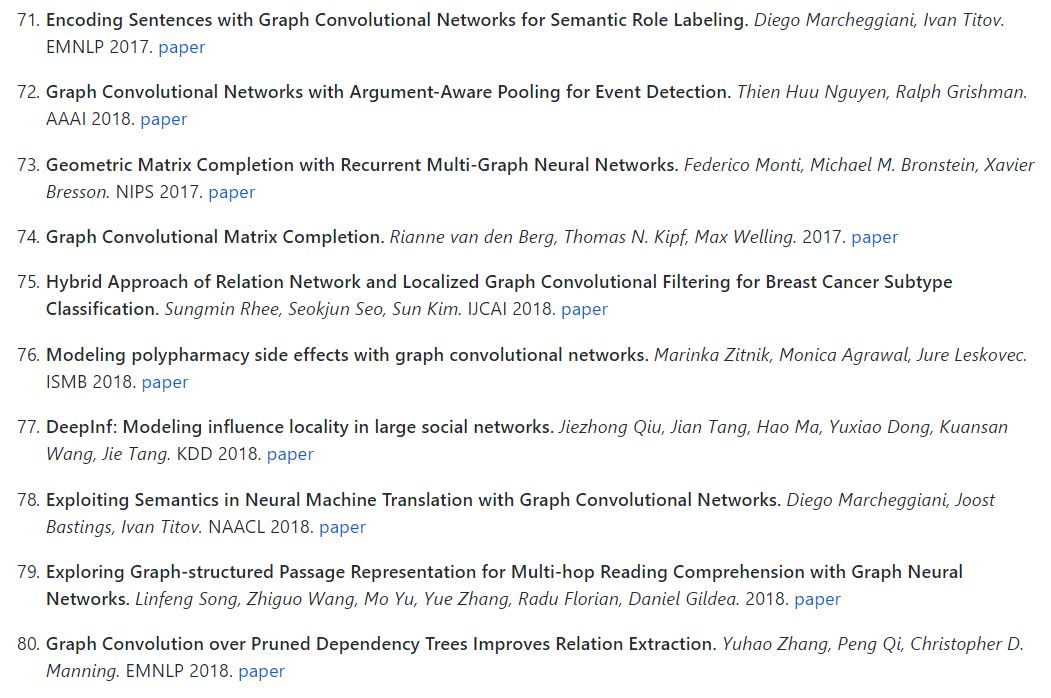

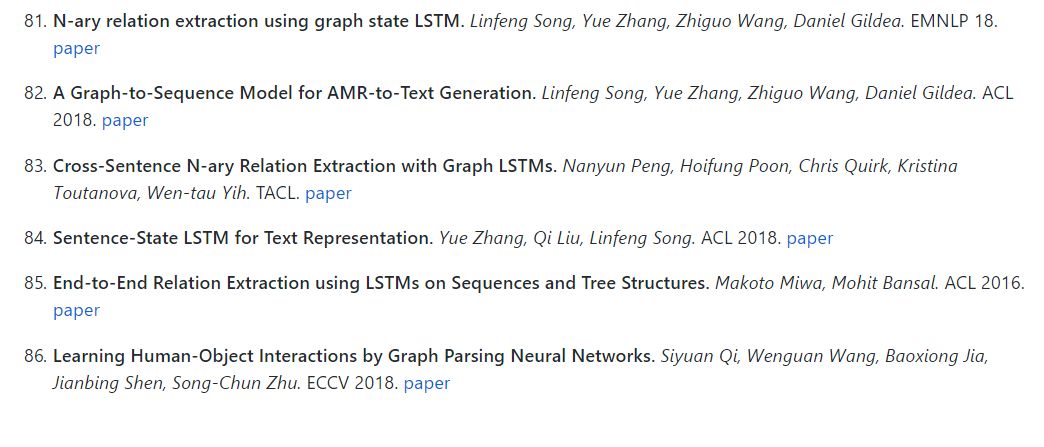

论文列表如下:

引用:http://www.sohu.com/a/284882212_129720